Jak będzie wyglądał świat, w którym upowszechniła się sztuczna inteligencja? Czy czeka nas nowa Zimna Wojna w obszarze technologii? Jak zmienią się rynek pracy i pola bitew i czy ludzie staną się na nich zbędni? – na te oraz inne pytania związane ze sztuczną inteligencją i technologią odpowiedział nam Dr Leszek Bukowski – specjalista w dziedzinie przetwarzania języka naturalnego i AI.

Michał Misiura, Bankier.pl: Jak może wyglądać świat działający w oparciu o sztuczną inteligencję, jeżeli wykorzystamy jej pełen potencjał?

Dr. Leszek Bukowski: Tych domen jest naprawdę wiele, dlatego nie wyrażę tu jakiejś jednej spójnej myśli. Raczej pojedyncze zdjęcia, które przychodzą mi do głowy. Kiedyś ktoś zapytał mnie, jak sztuczna inteligencja może wspierać demokrację. Dzisiaj mam wrażenie, że nasza perspektywa jest raczej negatywna. Podobnie było z rozwojem sieci społecznościowych i Internetu. Jeszcze na początku lat dwutysięcznych bardzo dużo osób miało przekonanie, że Internet przyczyni się do swobodnej wymiany myśli między ludźmi, że to zdecentralizowany system, w którym nie ma cenzury.

Okazało się, że jest inaczej. Po pierwsze Chiny zaczęły tworzyć swój osobny Internet, własny ekosystem ze słynnym Wielkim Firewallem. Cała masa aplikacji, z których korzystamy, nie jest tam dostępna. Mają własne odpowiedniki. Po drugie, pojawiła się kwestia dezinformacji i wpływu politycznego na przeróżne platformy, rozprzestrzeniania na nich fałszywych informacji, a czasami nie tyle fałszywych, co realizujących interes podmiotów, które postrzegamy jako wrogie wobec nas, np. Kremla.

Więc jeśli pomyślimy nad światem, w którym upowszechniła się sztuczna inteligencja, to z jednej strony mówi się o tym, że coraz trudniej będzie nam odróżnić prawdę od fałszu. Już teraz programista, który chce uruchomić kampanię dezinformacyjną z pomocą dużego modelu językowego, może zrobić to na masową skalę w ciągu kilku minut. Wygeneruje tysiąc lub dwa tysiące fałszywych informacji i podepnie je do botów, które roześlą je w sieciach społecznościowych. To się staje dużo łatwiejsze.

Stanisław Lem pisał w jednej ze swoich książek o powierzeniu polityki komputerowi. Jest trochę tak, że w zachodnich demokracjach zachodzi zjawisko formowania się środowiska osób, które zajmują się rządzeniem. Może zastąpilibyśmy je systemem komputerowym opartym o sztuczną inteligencję, która zarządzałaby państwem, a przynajmniej wzięła na siebie administracyjne obowiązki? Coraz więcej kwestii administracyjnych, zarówno w firmach prywatnych, jak i na poziomie państwowym, będzie powierzanych modelom językowym. Moim zdaniem to stanie się na pewno.

Być może sztuczna inteligencja pomoże nam również w kwestiach wymagających bezstronności. Odnosząc to do naszych wewnętrznych polskich problemów, od ponad ośmiu lat toczy się dyskusja związana z wyłanianiem sędziów do Trybunału Konstytucyjnego. Mamy alternatywę – niech sędziowie będą zamkniętą kastą i wybierają się sami, ale widzimy tu negatywne skutki. Możemy też włączyć do tego procesu polityków, ale to też wadliwe rozwiązanie, ponieważ oni zawsze realizują partyjne interesy i konflikty są nieuniknione. W USA próbuje się rozwiązać to w ten sposób, że sędziów do Sądu Najwyższego mianuje prezydent, ale to dożywotnia nominacja, więc wybrany w teorii nie jest już później nikomu nic winien, co zwiększa stabilność systemu.

Gdybyśmy potrafili stworzyć sztuczną inteligencję, która faktycznie byłaby bezstronna, być może rozwiązałaby wiele problemów. Służyła np. do wyłanianie najlepszych specjalistów do kierowania spółkami skarbu państwa, czy właśnie wybierała sędziów Trybunału Konstytucyjnego. Ale chcę podkreślić. To jest sztuczna inteligencja. Uczy się na pewnych danych. Jeżeli w tych danych zostaną zakodowane pewne skrzywienia lub tendencje polityczne, ten model będzie również te skrzywienia wykazywał.

Mamy więc dezinformację i administrację. Co jeszcze?

Kolejna domena to militaria, czyli jak zastosować uczenie maszynowe w obronności. To wiąże się z bardzo ciekawym zjawiskiem w świecie technologii. Przez lata było tak, że wynalazki opracowywano przez armię lub na jej potrzeby, a później wojskowe technologie trafiały pod strzechy. Suwaki, które znamy, powstały pod koniec I Wojny Światowej po o to, żeby spadochroniarze mieli sposób na szybkie otwarcie plecaka, w którym znajduje się czasza spadochronu. Dzisiaj zamek błyskawiczny jest czymś zupełnie naturalnym. Internet wiąże się z agencją DARPA, która prowadzi eksperymenty nad różnymi technologiami.

Dzisiaj wygląda to już trochę inaczej. Dajmy przykład amerykańskiej spółki zbrojeniowej Anduril. Jej założycielem jest osoba, która stworzyła wcześniej firmę Oculus, produkującą okulary do wirtualnej rzeczywistości i wykupioną przez Metę Marka Zuckerberga. Teraz osoby, które pracowały kiedyś przy Oculusie, pracują przy systemach uzbrojenia. Manifest firmy mówi, że w przeciętnym modelu Tesli jest teraz więcej uczenia maszynowego niż w jakimkolwiek systemie z jakiego korzysta amerykańska armia i jej celem jest to zmienić.

Przedstawiciele Pentagonu jeżdżą do Doliny Krzemowej, rozmawiają i namawiają coraz większą liczbę przedsiębiorców, żeby zaangażowali się w przemysł zbrojeniowy. Dwie czołowe militarne firmy technologiczne z USA to w tej chwili wspomniany Anduril oraz Palantir. Obie są obecne na Ukrainie w zasadzie od pierwszego dnia wojny. Rozmawiają z politykami, ale mają też swoje placówki w Kijowie. Tam pracują, zbierają dane. Pamiętajmy o tym. Wojna na Ukrainie jest oczywiście z polskiej, a tym bardziej z ukraińskiej perspektywy, dramatyczną sytuacją, ale te firmy zbierają tam masę danych, testują swoje rozwiązania i uczenie maszynowe.

Nie jestem specjalistą w technologiach obronnych, jednak z tego, co widzę i czytam, nadchodzące lata sprawią, że tego uczenia maszynowego będzie coraz więcej w systemach bojowych. Wiem, że dla wielu osób może to być przykre, ale sztuczna inteligencja jest lepszym pilotem niż człowiek. Pokazują to wszystkie testy. Jeśli z samolotów bojowych wyciągniemy pilota, nie będziemy musieli dbać o podsystemy chroniące człowieka, ani zwracać uwagi na przeciążenia, które można przeżyć. Maszyna jest o wiele trwalsza i wydajniejsza, a uczenie maszynowe pozwala na to, żeby była też lepiej sterowana.

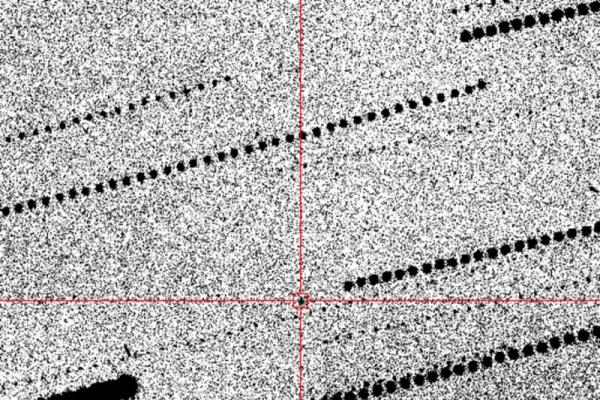

Kolejny obszar to dane wywiadowcze. Tak jak powiedziałem, uczenie maszynowe o wiele lepiej radzi sobie z analizą danych graficznych. Od 2017 roku w Stanach jest realizowany projekt Maven, w którym algorytm pomaga w analizie danych schodzących z amerykańskich satelitów oraz innych systemów wywiadowczych.

Tak więc administracja i wojskowość – tutaj te systemy będą obecne coraz częściej, gdybym miał podsumować to jednym zdaniem. Czasami to co się dzieje współcześnie, porównuje się do rewolucji przemysłowej z początku dziewiętnastego wieku i końca osiemnastego. Ja uważam, że to jednak coś dalece innego, bo my nie mówimy tutaj o nowego rodzaju urządzeniach. Mówimy o nowym sposobie sterowania urządzeniami. Stare systemy, które działały jeszcze zanim mieliśmy duże modele, mogą działać teraz bez ludzkiego sterowania. Operatorem może być sztuczna inteligencja.

Jest już chyba jasne, że AI zmieni rynek pracy. W jakim stopniu?

Bardzo często słyszę porównania, m.in. ze strony ekonomistów, że to co teraz się dzieje, przypomina dziewiętnasty wiek. Analizuje się dane historyczne z czasów rewolucji przemysłowej na temat zmian w strukturze zatrudnienia. Mówi się, że oczywiście bardzo wiele miejsc pracy zniknęło, ale przybyły nowe. Postęp technologiczny nie sprawił, że pracy zabrakło. Kolejna bardzo duża fala automatyzacji nastąpiła po drugiej wojnie światowej. To lata 50. i 60. Wtedy mamy to samo zjawisko. Stanowisk przybyło.

To tylko moja hipoteza, nie chcę, żeby traktować to w sposób autorytatywny, natomiast myślę, że te historyczne przykłady przebiegały w pewnym paradygmacie, w którym występowała maszyna i operator będący człowiekiem. Przybywało maszyn, więc przybywało operatorów. I gdy się nad tym zastanowimy, to w zasadzie praca każdego z nas jest w jakiś sposób związana z operowaniem na jakiejś maszynie. Nawet w pracach biurowych, naszym podstawowym narzędziem jest komputer.

Moim zdaniem teraz możemy znaleźć się w sytuacji, w której nastąpi zmiana paradygmatu. Tekst zostanie napisany w dużej mierze bez naszego udziału. Algorytm wykona za nas programistyczne zadania, generując kod. Jestem przeciwnikiem prostych kalek z przeszłości. Dzisiaj dzieje się coś innego. Są firmy, które podpinają uczenie maszynowe pod roboty. To jest rewolucja w sterowaniu maszynami.

Czyli ludzie mogą stać się zbędni?

To dotyka bardzo trudnej kwestii, również ze względów geopolitycznych. Niektórzy wychodzą z założenia, że powinniśmy zastosować jakiś społeczny filtr i postawić polityczną tamę. Pojawiają się głosy, że nie może tak być, że ta technologia rozwija się w tak niesamowicie szybkim tempie, a my natychmiast ją wdrażamy. Podnoszą się argumenty, że musimy dać społeczeństwu czas i postęp nie może się wiązać z krzywdą ludzi. Tak jest, ale do dyskusji tylnymi drzwiami wchodzi geopolityka.

Bo oczywiście z drugiej strony pada pytanie: co jeśli Zachód zatrzyma rozwój sztucznej inteligencji, a w tym czasie totalitarne reżimy, które postrzegają nas wrogo, nie zrobią tego, tylko pójdą na całość? To potężny dylemat, węzeł gordyjski, który teraz trzeba jakoś rozwiązać. Ja nie mam w tym wypadku dobrej odpowiedzi, natomiast dla firm w Dolinie Krzemowej wybór jest prosty. Z tego powodu zupełnie na serio podnoszony jest pomysł tzw. gwarantowanego dochodu.

W Dolinie Krzemowej coraz częściej mówi się, że skoro będziemy mieli maszyny, którymi sterują modele, powstanie system, który będzie pracował w zasadzie na całe społeczeństwo. Mówimy oczywiście o jakiejś przyszłości, ale niektórzy uważają, że wcale nie takiej dalekiej. Ten system będzie generować PKB, ale oczywiście najwięcej zarobi na nim kasta techno-oligarchów, zwiększając problem nierówności społecznych, które pogłębiają się w Stanach Zjednoczonych i na świecie.

Bardzo dużo analityków i komentatorów mówi o tym, że klasa średnia, będąca przez lata najważniejszą grupą społeczną w Ameryce, również w sensie ekonomicznym, zaczęła wymierać wraz z pojawieniem się big techów. Najprostszy przykład to Amazon, który sprawił, że ludzie przestali kupować produkty u lokalnych sklepikarzy. Mówię tu o sytuacji w USA, ale chcę pokazać trend. Te firmy realnie myślą o tym, że będziemy żyli w społeczeństwach, gdzie praca i zarobek to dwie różne rzeczy.

Jak może wyglądać ta przyszłość?

Tutaj również zderzają się dwie wizje. Jest nurt cyberpunk, ale jest też coś, co nazywa się solarpunkiem. To wizja przyszłości, w której technologia sprawiła, że życie stało się lepsze, ludzie zrozumieli, że potrzebny jest im zrównoważony rozwój, zaczęli dbać o planetę i po prostu realizują się w pracy, ale to nie jest niezbędne do utrzymania się. To właśnie jeden z nurtów.

Druga wizja jest gorsza i niestety coraz częściej widzimy, że świat może zmierzać w jej stronę. Ku niej się skłaniam, ale moje dzieciństwo przypada na lata osiemdziesiąte i dziewięćdziesiąte, także na moje patrzenie na świat miała też wpływ popkultura z tamtych lat, czyli na przykład Terminator, znany w Polsce jako elektroniczny morderca, cała seria Matrix. Wszystkie te filmy są osnute wokół tego samego problemu. To katastroficzne wizje konfliktu ludzi i maszyn.

To też trzeba powiedzieć jasno, wielu myślicieli mówi, że w tym wszystkim jest jednak bardzo duże niebezpieczeństwo. Bo jeżeli z jednej strony mamy maszyny, a z drugiej strony potrafiące nimi sterować modele, to mówiąc najprościej, w tym równaniu nagle zaczyna brakować miejsca dla homo sapiens. Pojawiają się głosy, że musimy się nad tym głęboko zastanowić. Niedawno w USA na zlecenie rządu powstał raport wykonany przez prywatną firmę konsultingową i w nim jest powiedziane, że należy postawić tamę i wstrzymać prace nad wszelkimi modelami sztucznej inteligencji.

Ale postępu nie da się zatrzymać?

Swoje spojrzenie na te tematy przejąłem od Stanisława Lema. On kiedy był młodszy, był techno-optymistą. To znaczy uważał, że technologia prowadzi nas do lepszego świata. W książkach, które pisał później, a szczególnie pod koniec swojego życia w latach dwutysięcznych, jego spojrzenie się zmienia. Wiele osób mówiło wówczas w samych superlatywach o Internecie. On już wtedy dostrzegał jego mroczną stronę.

Lem mówił, że technologia jest zmienną niezależną. Pisał, że żyjemy w cywilizacji naukowo-technicznej i wcześniej nie mieliśmy z czymś takim do czynienia. Z jednej strony mamy naukę, która rozpoznaje świat, a praktycznym odłamem tej nauki jest inżynieria, która tworzy technologię zmieniającą zupełnie nasze życie. Lem uważał też, że technologia jest tym co najbardziej determinuje zmiany kulturowe i cywilizacyjne w świecie.

W jego optyce związek nauki z techniką to samonapędzające się zjawisko. Używał tu porównania do rowerka, który zjeżdża z góry, nie ma hamulca i cały czas się rozpędza. Też myślę, że technologia jest zmienną niezależną, że te pojedyncze firmy w Dolinie Krzemowej to tylko ułamek całej układanki, ale całościowo nikt nad tym nie panuje i wyłączenie ich z wyścigu nie zatrzymałoby badań nad sztuczną inteligencją.

Co opłaca się umieć i wiedzieć o AI, żeby nie zostać w tyle?

Nie wiem na ten temat nic pewnego. Jestem tylko osobą, która skacze sobie po różnych wysepkach wiedzy. Zachęcałbym do tego, żeby porozmawiać z tymi systemami, otworzyć ChatGPT, poczytać na ich temat. W sieci pojawia się coraz więcej materiałów, także po polsku, pokazujących, jak rozmawiać z tymi systemami, bo korzystanie z nich wygląda trochę tak, że jeśli zadamy głupie pytanie, dostaniemy głupią odpowiedź.

Istnieje natomiast bardzo dużo prostych technik, które mogą pozwolić uzyskać nam od modelu dokładnie to co chcemy. Fachowa nazwa tego procesu to prompt engineering. Jeżeli potrzebujemy, żeby model wykonał dla nas coś bardziej skomplikowanego, czasami warto podać mu dwa, trzy przykłady, tego czego oczekujemy. Polecałbym więc, żeby porozmawiać z tymi systemami i podejść do tego, trochę jak do wstępu do programowania